Was bedeutet „Least Agency“?

Das Least-Agency-Prinzip besagt, dass einem autonomen System oder Software-Agenten nur so viel Handlungsmacht (Agency) eingeräumt wird, wie unbedingt nötig ist, um seine Aufgaben auszuführen. Alles, was darüber hinausgeht, wird bewusst verhindert oder eingeschränkt.

Anders ausgedrückt: Ein Agent sollte nur die Entscheidungsfreiheit und Handlungsmöglichkeiten besitzen, die für seine Aufgabe notwendig sind – nicht mehr. Dieses Konzept ist eine Weiterentwicklung der Idee klassischer Sicherheitsprinzipien wie dem Least-Privilege-Prinzip, geht aber einen Schritt weiter: Statt nur Zugriffsrechte zu begrenzen, geht es darum, die gesamte Handlungs- und Entscheidungsbefugnis eines Agenten bewusst zu begrenzen.

Warum ist das Prinzip wichtig?

Autonome Systeme und KI-Agenten können weitreichende Auswirkungen haben, insbesondere wenn sie Entscheidungen in sicherheitskritischen oder sensiblen Umgebungen treffen. Eine zu hohe Autonomie kann dazu führen, dass ein KI Agent Aktionen ausführt, die über seine vorgesehenen Aufgaben hinausgehen – zum Beispiel Zugriff auf Daten erhält, die er nicht benötigt, oder Eingriffe vornimmt, die nicht vorgesehen sind.

Das Least-Agency-Prinzip reduziert diese Risiken, indem es die Handlungsmöglichkeiten eines Agenten bewusst auf das absolut Notwendige beschränkt – ähnlich wie beim Least-Privilege-Prinzip, das Zugriffsrechte minimiert, jedoch in einem erweiterten Sinne: Es begrenzt, wie weitreichend ein Agent selbstständig handeln darf.

Ein konkretes Beispiel

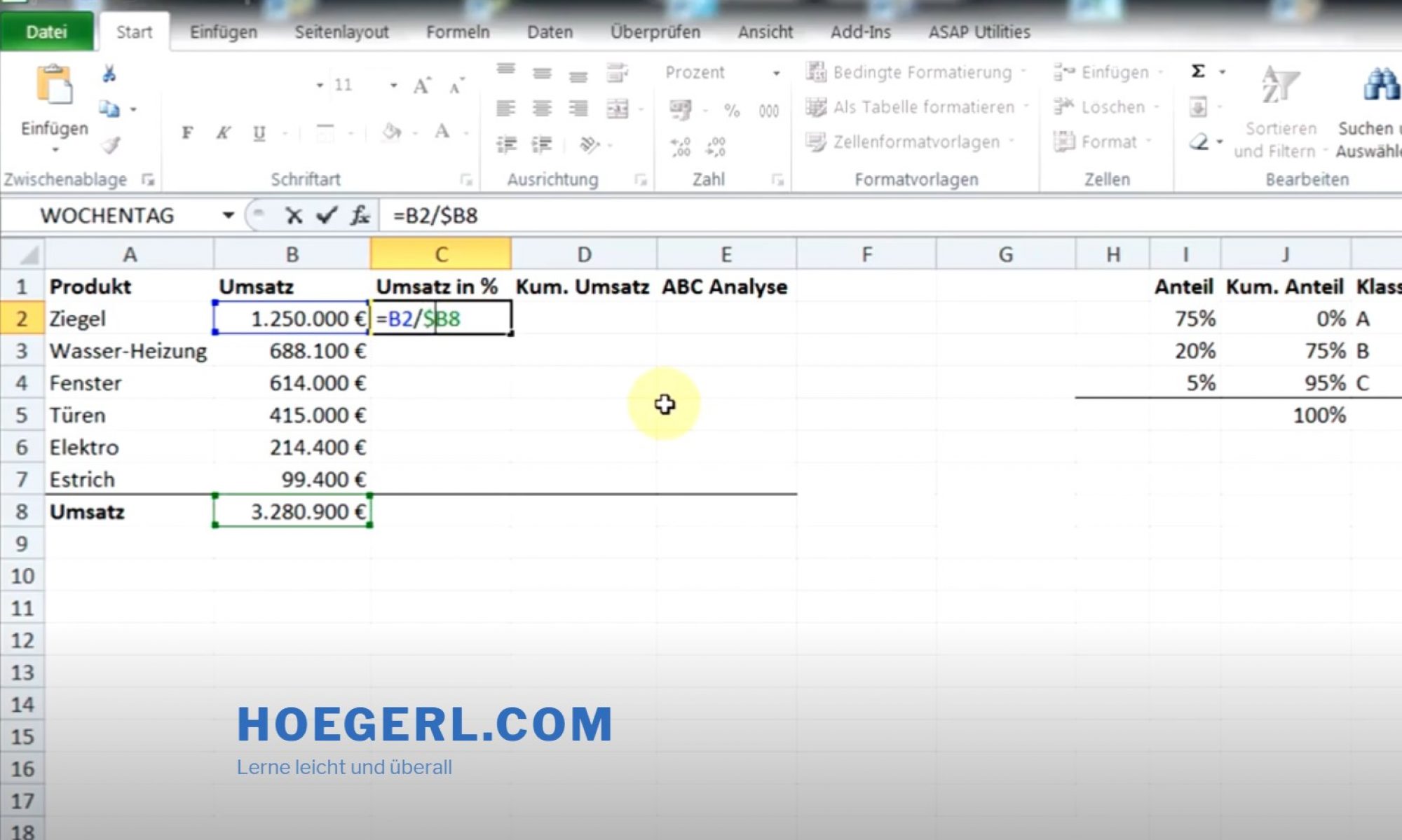

Stellen wir uns einen KI-Agenten vor, der Rechnungsdaten analysieren soll. Ein System, das nach dem Least-Agency-Prinzip gestaltet ist, erhält nur so viel Autonomie, wie nötig – etwa Zugriff auf die notwendigen Daten und Berechnungstools.

Was der KI Agent nicht bekommt:

- Zugriff auf nicht relevante Datenbanken

- Berechtigungen zum Löschen oder Verändern von Daten

- Unbegrenzte Nutzung weiterer APIs außerhalb der Aufgabe

Durch eine solche Begrenzung wird das Risiko unbeabsichtigter oder schädlicher Aktionen reduziert, und die Kontrolle über das System bleibt bei den Entwicklern oder Administratoren. Beachtet werden können unter Anderem die Menschenrechte der UN und die Roboter Regeln nach Asimov.

Unterschied zu ähnlichen Konzepten

- Least Privilege: Bezieht sich auf minimale Zugriffsrechte für Benutzer oder Prozesse.

- Least Agency: Bezieht sich auf die Beschränkung der *Handlungsmacht* und Entscheidungsfreiheit autonomer Systeme.

Diese Konzepte ergänzen sich, sind aber in ihrer Anwendung und Zielsetzung unterschiedlich.

Relevanz für die Praxis

Das Least-Agency-Prinzip spielt vor allem in Bereichen eine Rolle, in denen autonome Systeme in sicherheitskritische Prozesse eingebunden werden.

- Sicherheitsarchitekturen mit autonomen Modulen

- KI-gestützte Entscheidungsprozesse in Unternehmen

- Systeme mit sensiblen Daten, bei denen eine unbegrenzte Handlungsmacht Risiken birgt

Die bewusste Begrenzung von Handlungs- und Entscheidungsbefugnissen hilft, Risiken zu reduzieren und die Kontrolle über das Verhalten der Systeme zu behalten.

Fazit

Das Least-Agency-Prinzip ist ein modernes Gestaltungsprinzip für autonome Systeme, das fordert, die Autonomie eines KI Akteurs auf das absolut Notwendige zu begrenzen. Dadurch wird ein Beitrag zu Sicherheit, Zuverlässigkeit und kontrollierbarer Automatisierung geleistet – ohne die Problemlösungsfähigkeiten der Systeme unnötig einzuschränken.